大模型发展史:从一篇论文到改变世界

大家好,我是极客老墨。

有人问过我:学大模型开发,需要搞清楚历史吗?

我的答案是:不需要全记,但有几个节点绕不过去。就像你不需要知道 Linux 每一个版本的变化,但如果你不知道 1991 年 Linus 为什么会写内核、不知道 GPL 协议的来历,你就很难理解为什么今天的开源生态长成了现在这个样子。

大模型的历史也是一样的道理。

这篇文章不是"时间轴背诵手册",而是帮你搞清楚:每一个关键节点留下了什么技术遗产,以及这些遗产如何层层叠加,构成了你今天调用 API 时那个"黑盒"里的底层逻辑。

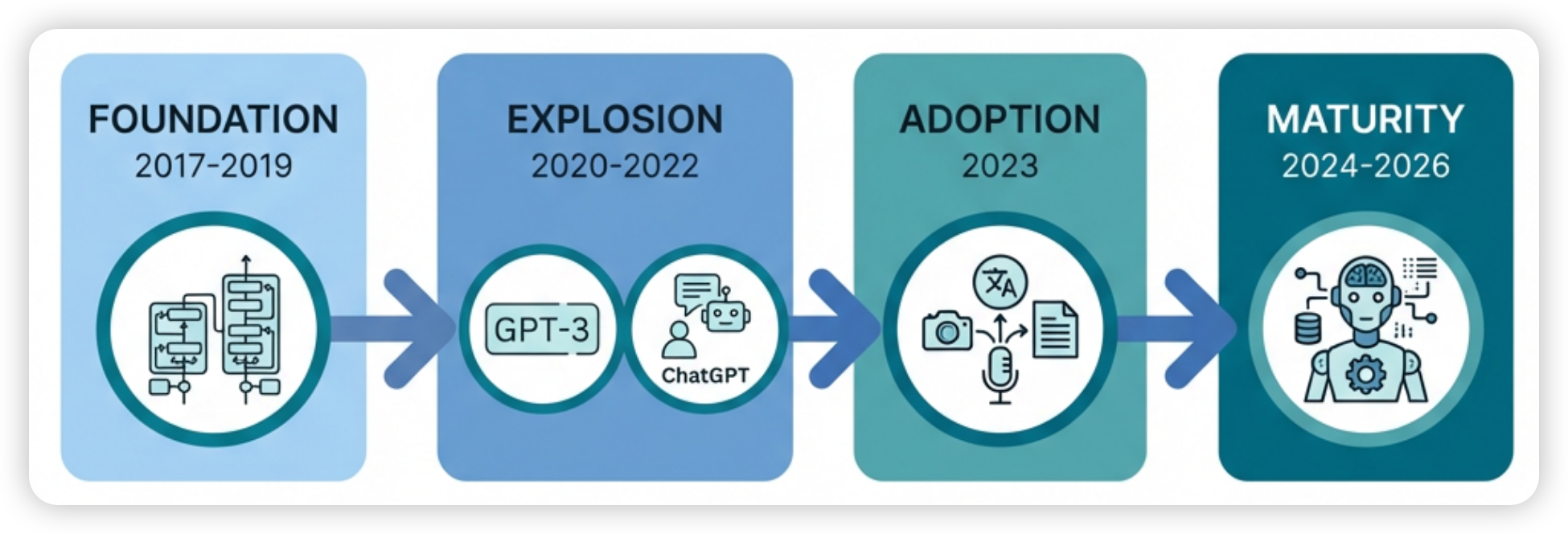

第一阶段:奠基期(2017–2019)——骨架确立,两条路线分叉

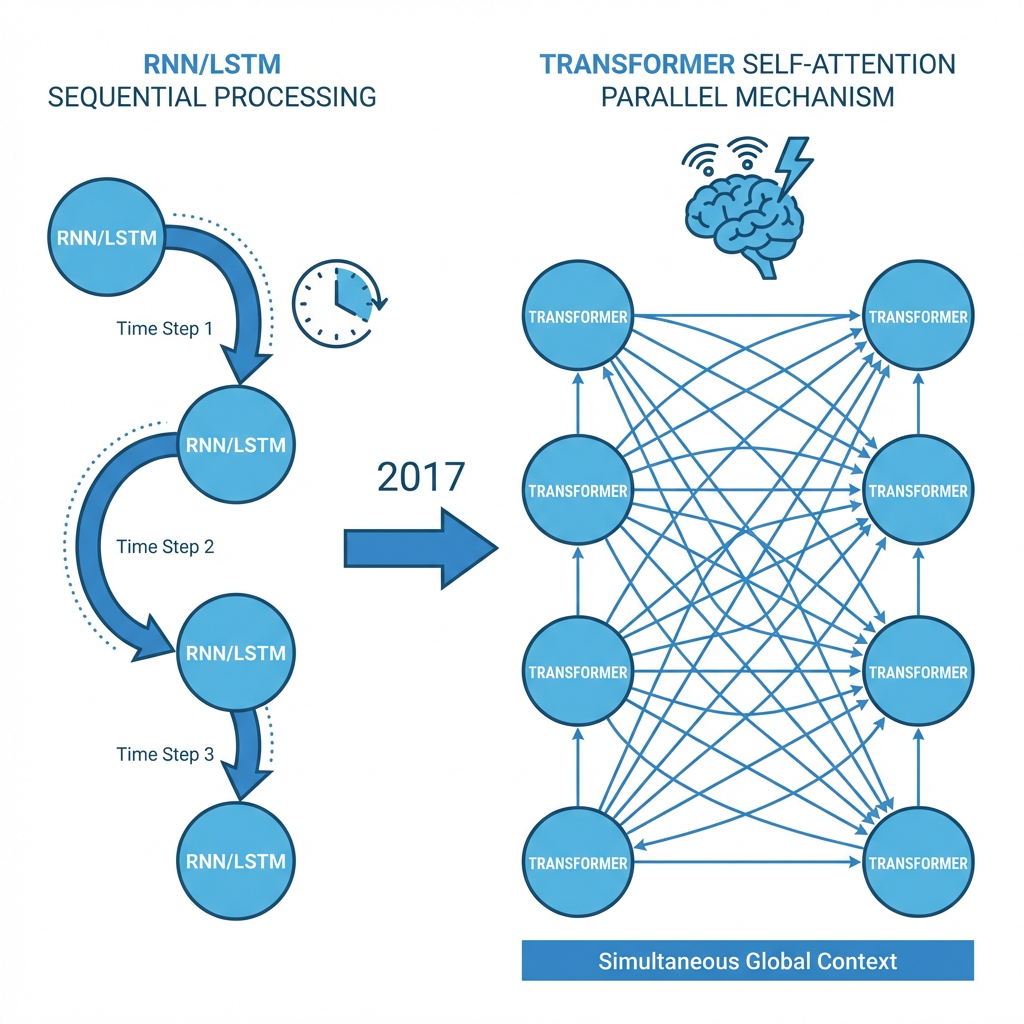

在 2017 年之前,AI 语言模型靠 RNN 和 LSTM 驱动。这两种架构有一个致命弱点:序列化处理——它们必须一个词一个词地读,前面没读完,后面没法算。这就导致了两个问题:长文本里的前后关联容易丢失,训练也难以并行,规模扩不上去。

这个局面被一篇论文打破了。

Transformer 诞生(2017 年 6 月)

Google Brain 团队的 Ashish Vaswani 等人发表了 Attention Is All You Need,提出了 Transformer 架构,核心是"自注意力机制(Self-Attention)"。

它的革命性在哪里?一句话:让模型在处理一个词的时候,能同时看到整个句子里所有词的关联权重,而不是只看"左边刚读过的"。 并且这个计算是可以并行的——GPU 的算力第一次被大模型充分用上了。

Transformer 由 Encoder(理解)和 Decoder(生成)两部分组成,可以灵活组合。这个设计直接决定了后来大模型的两条技术路线。

老墨说: Transformer 是大模型的底层骨架,今天你用的 GPT、Claude、DeepSeek,技术根基都在这篇 2017 年的论文里。你可以不懂数学,但"自注意力"这个词要知道它是干什么的。

两条路线分叉(2018 年)

Transformer 出来之后,OpenAI 和 Google 各自选了一条路。

GPT-1(2018 年 6 月,OpenAI):只用 Decoder,专注文本生成。1.17 亿参数,在约 5GB 的书籍语料上预训练,验证了"预训练+微调"在生成任务上的可行性。能力有限,但确立了 GPT 系列"纯 Decoder 生成式"的路线。

BERT(2018 年 10 月,Google):只用 Encoder,专注文本理解。有 Base(1.1 亿参数)和 Large(3.4 亿参数)两个版本,通过"掩码语言模型"预训练,能双向理解上下文。在 11 项 NLP 基准任务上刷新 SOTA,成为文本理解领域的标杆。

这两条路线的分叉意义深远:生成式(GPT 系列)走向了今天的 ChatGPT;理解式(BERT 系列)则深入搜索、问答、NER 等场景,也是国内百度 ERNIE 系列的起点。

2019 年的其他进展:

- GPT-2(2019 年 2 月):参数从 GPT-1 的 1.17 亿扩大到 15 亿,首次实现零样本学习——无需微调,直接完成翻译、摘要任务。OpenAI 当时认为它"太危险",一开始拒绝完整开源(后来全部公开了)。

- T5(2019 年 10 月,Google):把所有 NLP 任务统一成"文本→文本"格式,简化了多任务学习框架。

- ERNIE 1.0(2019 年 12 月,百度):首次把知识图谱融入预训练,“知识增强"思路从这里发端。

第二阶段:爆发期(2020–2022)——规模竞赛,能力涌现

Transformer 骨架确立了,接下来的问题变成:往里塞多少参数、喂多少数据,模型能变多强?

这个阶段的主旋律是"堆规模”。

GPT-3:千亿参数时代开幕(2020 年 5 月)

OpenAI 把参数堆到了 1750 亿,是 GPT-2 的 117 倍。训练数据约 570GB,用了 1024 块 V100,训练成本约 460 万美元。

参数多了,出现了之前没有的能力——这个现象被称为 “涌现能力(Emergent Abilities)” :模型规模超过某个阈值之后,突然会做训练时从没专门练过的事情,比如推理、代码生成、跨语言翻译。

更重要的是 In-Context Learning(上下文学习):你不需要微调模型,只要在 prompt 里给几个例子,它就能完成同类任务。这直接催生了"Prompt 工程"这个新职业。

GPT-3 没有开源,只提供 API 调用——这是大模型"API 服务化"商业模式的起点。

老墨说: GPT-3 证明了"缩放定律(Scaling Law)":参数量和数据量与能力正相关。这个发现改变了整个行业的研发策略,此后几年,大家比的就是谁堆得更大。

PaLM:纯 Decoder 的极限探索(2022 年 4 月)

Google 发布了 PaLM(Pathways Language Model),540 亿参数,同样是纯 Decoder 架构(不是 Encoder-Decoder)。训练数据约 7800 亿 tokens,在数学推理、逻辑推理、多语言处理上的表现超越了 GPT-3。

PaLM 只用于 Google 内部,未对外开放 API,主要用于优化搜索和 Workspace 产品。它的意义在于为 Gemini 系列铺路,也是 Google 在大模型参数规模上与 OpenAI 正面竞争的一次重要尝试。

Chinchilla:用数据打败参数(2022 年 3 月)

就在大家都在比谁的参数多的时候,DeepMind 发了一篇让行业重新思考的论文,并附带了模型 Chinchilla。

论文 Training Compute-Optimal Large Language Models 的核心结论是:用相同的算力,与其堆更多参数,不如喂更多数据。 模型参数量和训练 token 量应该"等比例增长",此前大家训练的模型普遍"数据喂得不够"。

Chinchilla 只有 700 亿参数,但用 1.4 万亿 tokens 训练——是同期 GPT-3 的 3.4 倍数据量。结果:用 GPT-3 十分之一的推理成本,达到了接近 PaLM(5400 亿参数)的性能。

这篇论文重新定义了大模型的训练哲学,也直接推动了后来"小参数+海量数据"路线(如 LLaMA 系列)的崛起。

ChatGPT:大模型破圈(2022 年 11 月 30 日)

上面那些模型,都是研究圈里的事。ChatGPT 把大模型带进了所有人的生活。

基础模型是 GPT-3.5(约 1750 亿参数),关键改变是加了 RLHF(Reinforcement Learning from Human Feedback, 基于人类反馈的强化学习):让人类标注者给模型输出打分,训练一个"奖励模型",再用这个奖励模型持续优化生成模型。结果是让 AI 从"能回答"进化成了"愿意好好回答"。

两个月,1 亿月活用户。史上增长最快的消费级应用。

老墨说: RLHF 解决的不是"模型能不能做"的问题,而是"模型愿不愿意按你的方式做"的问题。这个差别,决定了 ChatGPT 和之前所有大模型在用户体验上的本质区别。

2021–2022 年的其他进展:

- 国产大模型起步:百度 ERNIE 3.0 Titan(千亿级)、华为盘古 α(1000 亿参数)、清华 GLM-130B(中英双语)相继发布。

- LLaMA 1(2023 年 2 月,Meta):70 亿、130 亿、700 亿等多个版本,完全开源,掀起了开源大模型生态的浪潮。

第三阶段:普及期(2023)——多模态、百模大战、效率革命

ChatGPT 引爆之后,整个行业都动了。2023 年的主旋律是三个并行:多模态能力跃升、国内百模大战、开源模型崛起。

GPT-4:多模态时代开幕(2023 年 3 月)

参数未公开(专家推测是万亿级 MoE 架构),但对开发者来说,有三点关键:

第一,真正的多模态:同时接受文本和图像输入,能看图表、读手写文字、理解截图里的代码。这是质变,不是量变。

第二,推理能力飞跃:通过了律师资格考试(前 10%),通过了美国医学执照考试。以前你会怀疑大模型能不能胜任专业任务,GPT-4 之后这个疑问基本消散了。

第三,幻觉率大幅下降:生成内容的准确性显著提升,开始可以用于法律、医疗、金融等对准确性有要求的场景。

上下文窗口从 8K 升级到 32K tokens。API 开放,商业化模式成熟(每月 20 美元的 ChatGPT Plus,或按 token 计费的 API)。

Mixtral 8x7B:MoE 走向主流(2023 年 12 月)

Mistral AI 发布了 Mixtral 8x7B,这是 MoE(混合专家)架构大规模普及的标志性事件。

MoE 的逻辑是:不是每次推理都激活全部参数,而是让不同"专家模型"按需激活。Mixtral 总参数约 560 亿,但推理时只激活约 140 亿(两个专家),性能接近 700 亿参数的密集模型,速度快 2-3 倍,成本低一半。

完全开源,可商用,可本地部署——MoE 架构从此成为国内外大模型的主流选择(DeepSeek-V3、豆包、GLM-4.5 都用了这个架构)。

国内百模大战(2023 年 4 月–12 月)

GPT-4 发布两周后,国内科技公司的 PPT 上开始密集出现"大模型战略"四个字。

- 百度文心一言(ERNIE 4.0):3 月发布,知识增强路线,中文理解强,率先支持多模态

- 阿里通义千问:4 月发布,深度绑定阿里云,电商、金融场景优先

- 腾讯混元:9 月发布,整合微信、腾讯云、游戏生态

- 字节云雀(豆包前身):10 月发布,长上下文+多模态,抖音、飞书生态协同

- 智谱 GLM-4:12 月发布,代码生成能力突出,开源友好

MiniMax、Kimi(月之暗面)、DeepSeek 等初创公司也在这一年相继冒头,聚焦"长上下文"“低成本"“垂直场景”,差异化竞争。

老墨说: 百模大战的本质是"占位”——谁先把大模型能力接进自家生态,谁就在 AI 时代握住了入口。对开发者来说,这一年的最大红利是:接口越来越标准化(几乎全部兼容 OpenAI 格式),换模型的成本越来越低。

其他进展:

- Llama 2(2023 年 7 月,Meta):开源可商用,70 亿/130 亿/700 亿三个版本,开源模型的能力下限被大幅拉高。

- PEFT 技术普及:QLoRA、LoRA 等参数高效微调方案成熟,微调成本降到个人开发者可以承担的水平——不用 A100 集群,一张消费级 GPU 就能微调 70 亿参数的模型。

第四阶段:成熟期(2024–2026)——长上下文、Agent 化、国产突围

大模型从"令人惊叹的新玩具"变成了"需要认真集成的基础设施"。

Claude 3 系列:长上下文的标杆(2024 年 3 月)

Anthropic 发布 Claude 3(Opus / Sonnet / Haiku 三个版本),有几个数字值得记住:

- Opus 版 context window 达 100 万 tokens:约等于 75 万个英文单词,一整个中型代码库可以丢进去让它看

- 幻觉率:Anthropic 对外宣称降至行业最低,生成内容严谨性明显优于同期 GPT-4

Claude 3 系列建立了"高准确性场景首选 Claude"的市场认知。之后 Claude 持续迭代,Sonnet 4 的 API context window 进一步扩展到 1M tokens。

Gemini 1.5 + GPT-4o:多模态进入实时时代(2024 年 5 月)

Gemini 1.5(Google):context window 达 100 万 tokens(后来扩展到 1000 万 tokens 实验版),更重要的是实现了文本、图像、音频、视频的原生多模态统一——不是不同模型拼接,而是同一个模型同时理解多种输入。

GPT-4o(OpenAI):o 代表"omni",即全模态。支持实时语音对话,反应速度接近人类交谈节奏,推理速度比 GPT-4 快 2 倍,调用成本降低 50%。GPT-4o 之后,AI 对话产品开始从"打字交互"向"语音交互"迁移。

DeepSeek:用 1% 的成本打出顶级水准(2024 年末–2025 年初)

国产大模型里,DeepSeek 是最值得单独讲的。

2025年的1月20日,正当大家都在准备春节假期的时候,DeepSeek突然发布DeepSeek-R1 推理模型,轰动全球。核心原因:用极低算力和成本,做出对标 GPT‑o1 的推理能力,同时全栈开源、价格击穿行业,直接打破 “堆算力 = 强 AI” 的行业铁律,重塑全球大模型竞争格局。

据网上小道消息透露,梁文锋当时在武装的守护下在家吃了团圆饭。

DeepSeek的旗舰模型主要有两款:

- DeepSeek-V3:671 亿总参数(MoE,37 亿激活),训练成本约为 GPT-4 的 1%,代码生成和数学推理能力达到全球顶级水准。完全开源,接口兼容 OpenAI 格式。API 调用价格约为 GPT-4o 的 1/30。

- DeepSeek-R1:推理旗舰,内置长思维链(Chain of Thought),在数学、逻辑、复杂推理任务上进一步突破,同样开源。

DeepSeek 的出现打破了一个"常识":顶级大模型不再需要顶级算力预算。这对国内开发者是实质性利好——同样的性能,开发成本大幅下降。

国产大模型全面成熟(2024–2025 年)

- 豆包(字节):MoE 架构,支持 256K 上下文,多模态全栈,API 极低成本(约 0.0008 元/千 tokens),与抖音、飞书深度绑定

- Kimi(月之暗面):2M tokens 上下文,视觉编程能力突出(截图直接生成前端代码),长文档处理场景首选

- GLM-4.5(2025 年 7 月,智谱 AI):MoE 架构,355B 总参 / 32B 激活,代码生成和 Agent 工具调用能力突出,开源,MIT 协议可商用

- GLM-5(2026 年 2 月,智谱 AI):参数约为 GLM-4.5 的 2 倍,Coding 和 Agent 能力全球第三、开源第一,体感逼近 Claude Opus 4.5,专注复杂系统工程和长周期 Agent 任务;2026 年 3 月进一步迭代发布 GLM-5.1

- 通义千问、文心一言:强化企业级服务,专注行业微调(金融、医疗、教育),支持私有化部署

老墨说: 2024–2025 年是国产大模型真正成熟的两年。不是因为参数最大,而是因为在"性价比、中文能力、接口兼容性、本地部署"这几个对国内开发者最实际的维度上,真正做到了可用、好用。

2025–2026 年:Agent 化、轻量化、多模型协同

这一阶段的核心词不再是"参数多少",而是 “大模型能干什么活”。

- Agent 化:大模型具备了"自主规划→工具调用→多步骤执行"的能力,可以自动写代码、搜索信息、操作浏览器、处理工作流。你可以把它理解成:大模型从"会说话的助手"变成了"能干活的员工"。

- 轻量化:百亿参数以下的小模型性能逼近大模型,可以在手机、边缘设备上运行。端侧 AI 进入实用阶段。

- 多模型协同:一个应用里同时调用多个模型已经很普遍——用 Claude 处理长文档,用 DeepSeek-R1 做复杂推理,用豆包生成图像,API 格式兼容,调度成本低。

老墨说:2025年11月,开源Agent OpenClaw的首次发布和迅速走红,让AI从只能聊天的伙伴变成了"真正能干活的AI智能助手",彻底拉低了智能体开发与落地的门槛,重塑了 AI 智能体的开发范式与应用生态,是开源智能体从 “原型实验” 走向 “生产落地” 的里程碑。

核心里程碑速查表

| 时间 | 事件 | 核心突破 | 留下了什么 |

|---|---|---|---|

| 2017.06 | Transformer 诞生 | 自注意力机制,并行计算 | 所有现代大模型的底层骨架 |

| 2018.06 | GPT-1 | 纯 Decoder,预训练+微调 | 生成式大模型路线确立 |

| 2018.10 | BERT | 纯 Encoder,双向理解 | 理解式大模型路线,NLP 各项任务 SOTA |

| 2019.02 | GPT-2(15 亿参数) | 零样本学习 | 证明规模带来新能力 |

| 2020.05 | GPT-3(1750 亿参数) | 涌现能力,In-Context Learning | 缩放定律,Prompt 工程,API 商业化 |

| 2022.03 | Chinchilla | 数据量比参数量更重要 | 重新定义训练哲学,推动 LLaMA 路线 |

| 2022.04 | PaLM(540 亿参数) | 强推理,多语言,纯 Decoder | Gemini 系列的前身 |

| 2022.11 | ChatGPT | RLHF,多轮对话对齐 | AIGC 全民化,Prompt 技术普及 |

| 2023.02 | LLaMA 1(Meta) | 开源多规格模型 | 开源大模型生态起点 |

| 2023.03 | GPT-4 | 多模态,强推理,32K 上下文 | 多模态时代开启 |

| 2023.12 | Mixtral 8x7B | MoE 架构,开源可商用 | MoE 成为主流架构 |

| 2023 全年 | 国内百模大战 | 中文能力,本地化,生态绑定 | 国产大模型体系成型 |

| 2024.03 | Claude 3 系列 | 1M tokens 上下文,低幻觉 | 长文本处理场景标杆 |

| 2024.05 | GPT-4o / Gemini 1.5 | 实时多模态,超长上下文 | 交互从文字走向语音/视频 |

| 2024–2025 | DeepSeek-V3 / R1 | 1% 成本,顶级水准,开源 | 打破"大模型必须大预算"的认知 |

| 2026.02 | GLM-5(智谱 AI) | Coding/Agent 开源第一,逼近 Claude Opus | 国产开源大模型能力跃升新标杆 |

| 2025–2026 | Agent 化、轻量化 | 自主执行,端侧部署 | 大模型从工具变成生产力基础设施 |

老墨总结

回头看这段历史,有一条隐约的主线:技术每一次突破,都是为了解决上一个阶段的瓶颈。

Transformer 解决了 RNN 的并行瓶颈;GPT-3 证明了规模的价值;Chinchilla 纠正了"只堆参数"的偏差;RLHF 解决了"模型能做但不愿意好好做"的对齐问题;MoE 解决了大参数的推理成本问题;Agent 在解决"模型能说但不能做"的行动力问题。

每一步都踩在前一步的肩膀上。

作为开发者,你不需要精通每一个技术细节,但你需要知道:你今天用的 API 背后,是这些积累叠加出来的。知道历史,在遇到具体问题时(比如为什么 context 超长后质量下降,为什么某些任务要用推理模型),你才有直觉去找方向,而不是盲目试探。

下一篇,我们进入大模型的工作原理——从"输入→Token→推理→输出",把这个黑盒拆开来看看里面有什么。

文章有帮助?转发给同样在踩坑的朋友。有不同意见?评论区见。

关注公众号:极客老墨

更多 AI 应用开发、工程实践和效率工具分享,欢迎扫码关注。